AI&アルゴリズム監査

AI & Algorithm Audit 代表的なサービス

AI & Algorithm Audit 代表的なサービス

出所:TTL "Talent Acquisition Technology Ecosystem 11(2023.1)

AI&アルゴリズム監査は、AI(機械学習)モデルやアルゴリズムの有効性、説明可能性、公平性などを評価・検証し、一定基準を満たしていることを保証したり、AIやアルゴリズムが搭載されたシステムのパフォーマンスを監視する製品およびサービスである。

AIやアルゴリズムは、日常のさまざまな場面で利用されている。多くの企業が、採用選考において、ビデオ面接における候補者の自動採点や、履歴書の自動スクリーニングなど、AIが導入されたHRテクノロジーを利用している。Mercerの2021年の調査によると、米国の人事部リーダーの55%が採用の意思決定に、入社後の活躍などを予測するアルゴリズムを「使用している」と回答した。

企業にとって採用選考でのAIの活用は、多数の応募者のなかから候補者を効率的に絞り込み、選考スピードを向上できるといったメリットがある。一方、AIの機械学習で用いる学習データには、性別や人種や年齢などの偏りや開発者のバイアスが含まれている可能性がある。学習データの偏りやバイアスがあると、特定の属性を持つ候補者が不当に差別され、不採用の割合が多くなるなど、公平性を欠いた判断結果につながる。

採用選考でのAIの活用が進むなか、ニューヨーク市は2023年7月に、採用や昇進の判断において自動化された雇用決定ツール(AEDT)の利用を規制する法律「Local Law 144」を施行した。AEDTを利用する企業は、性別や人種、民族に基づくバイアスの有無を第三者機関が分析するバイアス監査を毎年実施し、その結果を自社のウェブサイトで公表しなければならない。

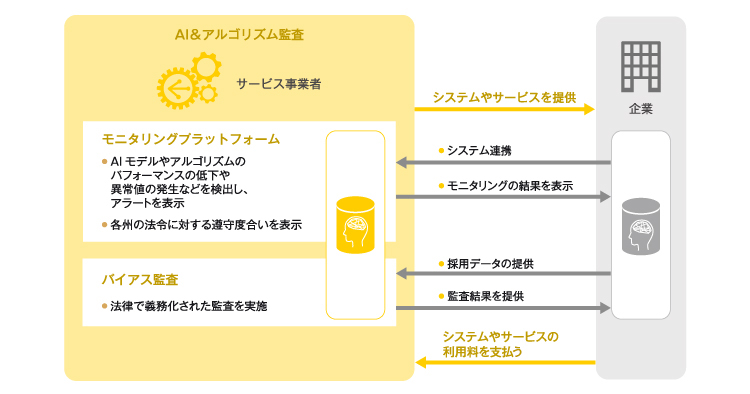

AI&アルゴリズム監査のサービス事業者は、法律で義務化された監査や、企業が自社システム搭載のAIやアルゴリズムのパフォーマンスを本番環境下で自ら監視できるセルフサービス型のモニタリングプラットフォームを提供する。モニタリングプラットフォームは、パフォーマンスの低下や異常値の発生などの問題をリアルタイムに検出し、視覚化する。AIモデルがなぜそのような判断や予測を行うのかをユーザーが理解できるような形で示し、AIの「説明可能性」を確保する。

サービス事業者の概要は下記のとおりである。

- 金融機関、保険会社、HRテクノロジー、医療機関、政府機関&防衛産業向けのモニタリングプラットフォーム。各州の法令に対する遵守度合いをパーセンテージで示す。Credo AIがバイアス監査を行い、結果を提供するサービスもある。信頼性・公平性の高いAIシステムの構築・運用をサポートする。2023年6月にCB Insights の世界で最も有望なAIスタートアップ100社「AI100」に選ばれた。(Credo AI)

- カスタマーのセグメント別に特定の商品やサービスを推奨するレコメンデーションや、クレジットカードやローンの自動審査、サプライチェーンの需要予測などのシステムに対応するモニタリングプラットフォーム。Forbes誌の2021年「AI 50」などに選ばれた。(Fiddler)

- AIの予測や判断の評価・検証に加えて、学習データや本番環境下でAIに供給されるデータの監視も行うモニタリングプラットフォーム。データドリフト(※1)やバイアスなどの問題を検出し、Slack やMicrosoft Teamsに通知する。2023年に世界経済フォーラムの「Technology Pioneers」に選ばれた。(Aporia)

人事との関連性

企業は、AI監査を受けたHRテクノロジーを利用して、自社のシステムのモニタリングを行うことで、システムの公平性や安全性を証明し、求職者からの信頼を高めることができる。また、各州の法令違反や、個人情報などの漏洩に伴う金銭的ペナルティ、炎上、訴訟を回避できる。

サービス例

1. ORCAA(O'Neil Risk Consulting and Algorithmic Auditing)

AI監査の第一人者であるキャシー・オニール博士が創設したコンサルティング会社である。ニューヨーク市の「Local Law 144」が企業に義務づけるバイアス監査、AIガバナンスおよびリスク管理コンサルティング、AIのリスクや監査技術などに関する教育・研修のサービスを提供する。生成AI、自動意思決定システム、予測モデル、顔認識技術といった、雇用・保険・教育・医療・信用調査などで利用される多様なシステムに対応する。顧客はHireVue、Airbnb、Siemens、ワシントンD.C.地区保険・証券・銀行局(Department of Insurance, Securities and Banking)、コロラド州保険局、ワシントン州運転免許認可局(Department of Licensing)、イリノイ州司法局(Office of the Attorney General)など。

2. Holistic AI

AIのリスク管理およびモニタリングプラットフォームである。企業は、自社のシステムに導入されているAIの有効性・堅牢性(動的な変化やシステムへの攻撃によって故障するリスク)・プライバシー(個人情報などのデータ漏洩)・バイアス・説明可能性の5つのリスクをプラットフォーム上で特定できる。

Holistic AIは、ニューヨーク市の「Local Law 144」が義務づけるバイアス監査サービスを提供する。人材のソーシングや求人とのマッチング、アセスメントなど採用や昇進の判断をする際に、性別、民族、人種などによる差別を生じていないかどうか、企業のシステムを分析する。監査結果の要約や法改正など最新情報の提供、企業のニーズに合ったコンプライアンスプランの作成も行う。

さらに、EUの「デジタルサービス法(Digital Services Act)」(※2)やAI規制法案の「AI Act」(※3)に適合したサービスも提供する。

顧客はUnilever、Cisco、Adecco、Hired、Jobvite、UKG、Bryq、Starling Bank、MindBridge、RHR International など。Holistic AIは、2023年6月にCB Insightsの「AI 100」に選ばれた。

ビジネスモデル(課金形態)

企業はサービス事業者に監査サービスやモニタリングプラットフォームの利用料を支払う

今後の展望

2022年にChatGPTをはじめとする生成AI技術の社会実装が急速に発展し、倫理的な問題や、プライバシー・セキュリティなど、AIが社会や個人にもたらす潜在的なリスクに対する懸念が高まっており、規制強化の動きがある。

ニューヨーク市に続いて、現在、カリフォルニア州やマサチューセッツ州、ワシントンD.C.地区でも、差別につながる自動判断ツールの使用を禁止する法案が提出されている。

また、AIには判断基準やプロセスが見えないという「ブラックボックス」の問題もある。政府や企業は解決策として、AIの判断過程を明確にする「説明可能なAI(XAI)」 の開発の重要性を指摘している。今後もAIの活用は急増すると見込まれており、企業が自社のシステムにバイアスがないことを証明する必要性は高まる。

グローバルセンター

(※1)モデル訓練時とテスト時/本番環境下での入力データの統計的分布が、何らかの変化によってずれている現象を指す。

(※2)ソーシャルメディアやオンラインマーケットプレイス、検索エンジンなどに適用される。

(※3)EU域内でAIシステムを提供するプロバイダーや同域内でAIのアウトプットを利用するユーザーなどに提供される。

メールマガジン登録

メールマガジン登録 各種お問い合わせ

各種お問い合わせ